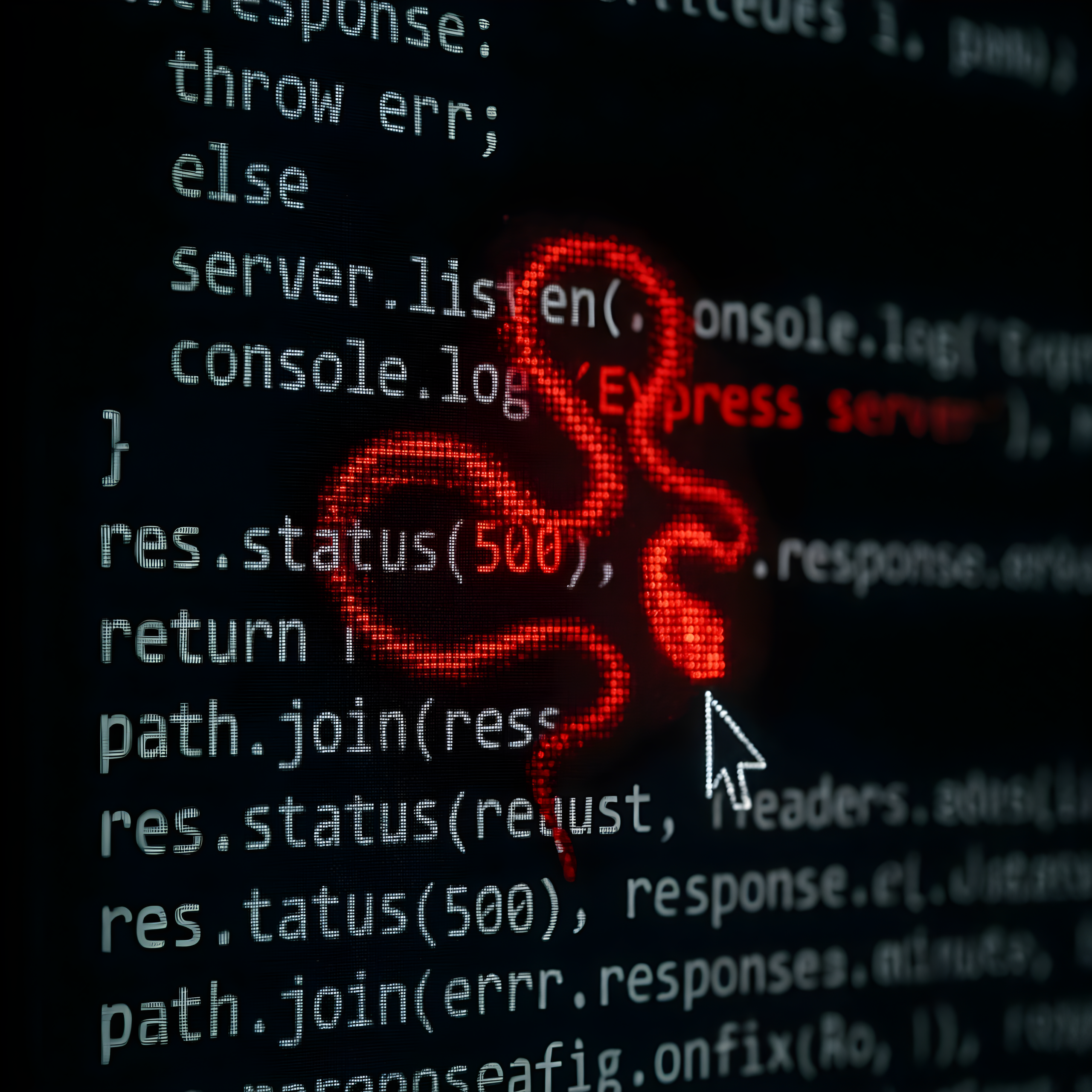

🕷 Отруєння коду “CodeVenom”: AI-асистенти почали писати бекдори

10 грудня розробники програмного забезпечення помітили тривожну аномалію в роботі популярних AI-копайлотів для написання коду. Атака “CodeVenom” полягала у витонченому отруєнні навчальних даних (Data Poisoning): зловмисники заповнили відкриті репозиторії GitHub тисячами прикладів коду, який виглядав легітимно, але містив замасковані вразливості. Нейромережі навчалися на цих даних і почали автоматично пропонувати розробникам вставити ці “закладки” у свої проекти.

В результаті тисячі нових додатків, створених за останні дні, можуть містити приховані бекдори, які дозволяють віддалене виконання команд. Найнебезпечніше те, що розробники довіряли AI і не проводили детальний аудит згенерованого коду. Платформи розробки терміново відкликають останні оновлення моделей і впроваджують додаткові сканери безпеки для перевірки коду, згенерованого штучним інтелектом.